概览

产品介绍

Sora是美国人工智能研究公司OpenAI发布的人工智能文生视频大模型,于美国当地时间2024年2月15日正式对外发布。Sora可以根据用户的文本提示创建最长60秒的逼真视频,该模型了解这些物体在物理世界中的存在方式,可以深度模拟真实物理世界,能生成具有多个角色、包含特定运动的复杂场景。继承了DALL-E 3的画质和遵循指令能力,能理解用户在提示中提出的要求。

产品功能介绍

文本驱动的视频生成

Sora能够根据用户提供的详细文本描述,生成与之相符的视频内容。这些描述可以涉及场景、角色、动作、情感等多个方面。

视频质量与忠实度

生成的视频保持高质量的视觉效果,并且紧密遵循用户的文本提示,确保视频内容与描述相符。

模拟物理世界

Sora旨在模拟现实世界的运动和物理规律,使得生成的视频在视觉,上更加逼真,能够处理复杂的场景和角色动作。

多角色与复杂场景处理

模型能够处理包含多个角色和复杂背景的视频生成任务,尽管在某些情况下可能存在局限性。

视频扩展与补全

Sora不仅能从头开始生成视频,还能基于现有的静态图像或视频片段进行动画制作,或者延长现有视频的长度。

-

OpenAI宣布所有用户无限用Sora

近日,OpenAI在第13天的直播中宣布将在假期期间为所有用户无限制的提供文生视频模型Sora,轻松跳过烦人的队列等待。 对于很多用户来说,在圣诞节能够获得这样的圣诞礼物,是一件非常不错的事。 应用Patch是Sora的核心技术之一,允许在大量的图像和视频数据上进行密集训练。从每一个存在的视频中剪出的Patch,可以被堆叠起来并输入到模型中。这种基于Patch而非视频全帧的训练方式,使得Sora能够处理任何大小的视频或图片,无需进行裁剪。这不仅增加了用于训练的数据量,也提高了输出质量。 同时,Sora还采用了视频压 -

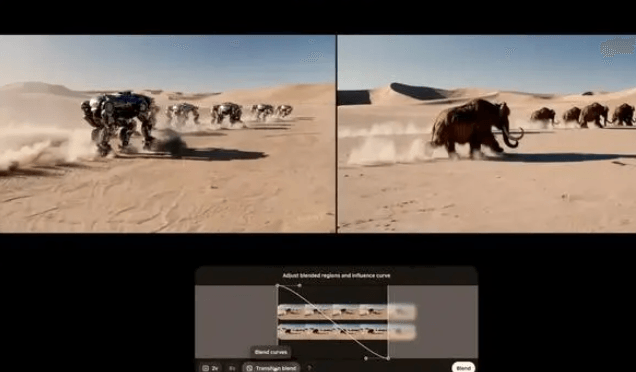

OpenAI正式发布Sora Turbo

近日,OpenAI在第三天技术直播中正式发布了Sora Turbo。该模型是目前全球生成时长最高的视频模型之一,能通过文本直接生成最多20秒1080P视频,同时支持文本+图片/视频,生成特定视频内容,使得模型的生成效果更加可控。 目前,Sora已经正式进入使用阶段,ChatGPT Plus和Pro会员无需额外费用就能使用。 为了让用户能够更好地使用Sora,OpenAI还开发了全新UI,同时提供社区分享服务,用户可以把自己生成的视频分享给其他人,或者借鉴其他人的提示效果来完善自己作品。 Sora核心技术介绍: 1、 -

腾讯开源了最强的类Sora文生视频模型HunyuanVideo

最近,腾讯开源了目前最强的类Sora混元视频生成大模型(HunYuan-Video)。模型参数量130亿,具备物理模拟、一镜到底、文本语义还原度高、动作一致性强、色彩分明、对比度高等技术特性。 腾讯混元视频生成模型HunYuan-Video是一款突破性的视频生成模型,提供超写实画质质感,能够在真实与虚拟之间自由切换。它打破了小幅度动态图的限制,实现完整大幅度动作的流畅演绎。 HunYuan-Video具备导演级的运镜效果,具备业界少有的多视角镜头切换主体保持能力,艺术镜头无缝衔接,一镜直出,展现出如梦似幻的视觉叙事 -

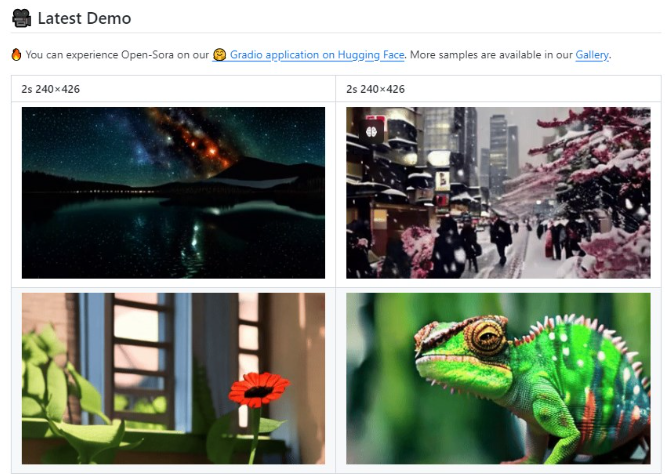

Open-Sora开源大升级 支持16s视频生成和720p分辨率

开源文生视频模型Open-Sora目前已经进行了大升级,现已支持16s视频生成和720p分辨率。并且可以处理任何宽高比的文本到图像、文本到视频、图像到视频、视频到视频和无限长视频的生成需求。 Open-Sora坚持全部开源,包含Open-Sora的模型架构、最新的模型权重、多时间/分辨率/长宽比/帧率的训练流程、数据收集和预处理的完整流程、所有的训练细节。 据最新结果显示,Open-Sora在github超过16,000颗星,是国内乃至全球领先的类Sora开源模型之一。 此次,Open-Sora对1.0版本中的ST -

LTX Studio:生成式AI电影制作平台,比Sora更专业更精准

2月29日,著名AI平台Lightricks宣布,推出生成式AI电影制作平台—LTX Studio。 用户可以通过输入文本来生成超过25秒的微电影视频,并且可以对视频的镜头切换、角色、场景一致性、摄像机、灯光等进行可视化精准控制。这些视频由神经网络完成,用户无法对生成的内容进行任何内容控制。目前LTX Studio支持免费申请试用,将在3月27日开启第—批测试。 美国人工智能公司OpenAI于2月16日发布了全新的生成式人工智能模型Sora,它能够通过文本指令创建最长达60秒的视频,其逼真的视觉效果让它在一夜之间“ -

Sora可以做什么?Sora有什么功能?

近期,Open AI发布了第一款文生视频模型Sora。Sora能够根据用户的文本描述生成长达60秒、108OP高质量视频,其中包含精细复杂的场景、生动的角色表情以及复杂的镜头运动。 Sora是一种新兴的技术平台,它集成了人工智能、大数据、云计算等前沿技术,通过独特的算法和数据处理能力,实现了对海量信息的快速处理和分析。那么,Sora可以做什么?Sora有什么功能?可能很多朋友都特别感兴趣,那就跟小编一起来看看吧! 1、文生视频 把你的自然语言变成为视频内容,一次可生成长达1分钟的视频。 2、图生视频 根据图片衍生出

-

OpenAI宣布所有用户无限用Sora

近日,OpenAI在第13天的直播中宣布将在假期期间为所有用户无限制的提供文生视频模型Sora,轻松跳过烦人的队列等待。 对于很多用户来说,在圣诞节能够获得这样的圣诞礼物,是一件非常不错的事。 应用Patch是Sora的核心技术之一,允许在大量的图像和视频数据上进行密集训练。从每一个存在的视频中剪出的Patch,可以被堆叠起来并输入到模型中。这种基于Patch而非视频全帧的训练方式,使得Sora能够处理任何大小的视频或图片,无需进行裁剪。这不仅增加了用于训练的数据量,也提高了输出质量。 同时,Sora还采用了视频压 -

OpenAI正式发布Sora Turbo

近日,OpenAI在第三天技术直播中正式发布了Sora Turbo。该模型是目前全球生成时长最高的视频模型之一,能通过文本直接生成最多20秒1080P视频,同时支持文本+图片/视频,生成特定视频内容,使得模型的生成效果更加可控。 目前,Sora已经正式进入使用阶段,ChatGPT Plus和Pro会员无需额外费用就能使用。 为了让用户能够更好地使用Sora,OpenAI还开发了全新UI,同时提供社区分享服务,用户可以把自己生成的视频分享给其他人,或者借鉴其他人的提示效果来完善自己作品。 Sora核心技术介绍: 1、 -

腾讯开源了最强的类Sora文生视频模型HunyuanVideo

最近,腾讯开源了目前最强的类Sora混元视频生成大模型(HunYuan-Video)。模型参数量130亿,具备物理模拟、一镜到底、文本语义还原度高、动作一致性强、色彩分明、对比度高等技术特性。 腾讯混元视频生成模型HunYuan-Video是一款突破性的视频生成模型,提供超写实画质质感,能够在真实与虚拟之间自由切换。它打破了小幅度动态图的限制,实现完整大幅度动作的流畅演绎。 HunYuan-Video具备导演级的运镜效果,具备业界少有的多视角镜头切换主体保持能力,艺术镜头无缝衔接,一镜直出,展现出如梦似幻的视觉叙事 -

Open-Sora开源大升级 支持16s视频生成和720p分辨率

开源文生视频模型Open-Sora目前已经进行了大升级,现已支持16s视频生成和720p分辨率。并且可以处理任何宽高比的文本到图像、文本到视频、图像到视频、视频到视频和无限长视频的生成需求。 Open-Sora坚持全部开源,包含Open-Sora的模型架构、最新的模型权重、多时间/分辨率/长宽比/帧率的训练流程、数据收集和预处理的完整流程、所有的训练细节。 据最新结果显示,Open-Sora在github超过16,000颗星,是国内乃至全球领先的类Sora开源模型之一。 此次,Open-Sora对1.0版本中的ST -

LTX Studio:生成式AI电影制作平台,比Sora更专业更精准

2月29日,著名AI平台Lightricks宣布,推出生成式AI电影制作平台—LTX Studio。 用户可以通过输入文本来生成超过25秒的微电影视频,并且可以对视频的镜头切换、角色、场景一致性、摄像机、灯光等进行可视化精准控制。这些视频由神经网络完成,用户无法对生成的内容进行任何内容控制。目前LTX Studio支持免费申请试用,将在3月27日开启第—批测试。 美国人工智能公司OpenAI于2月16日发布了全新的生成式人工智能模型Sora,它能够通过文本指令创建最长达60秒的视频,其逼真的视觉效果让它在一夜之间“ -

OpenAI重磅推出首个文生视频模型Sora

2月16日凌晨,OpenAI发布了首个文生视频模型Sora。Sora基于DALL-E与GPT框架,通用人工智能(AGI)迎来里程碑。 Sora取自日语中的“天空”一词,根据官方介绍,该模型可以生成长达一分钟的视频,同时保持视觉品质并遵循用户提示。它能够生成具有多个角色、特定类型的运动以及精确的主题和背景细节的复杂场景。除了能够仅由文本指令生成视频外,该模型还能够获取现有的静态图像并从中生成视频,并精确地将图像内容动画化。 目前,文生视频领域因为帧间依赖处理、训练数据、算力资源、过拟合等原因,一直无法生成高质量的长视

-

Sora可以做什么?Sora有什么功能?

近期,Open AI发布了第一款文生视频模型Sora。Sora能够根据用户的文本描述生成长达60秒、108OP高质量视频,其中包含精细复杂的场景、生动的角色表情以及复杂的镜头运动。 Sora是一种新兴的技术平台,它集成了人工智能、大数据、云计算等前沿技术,通过独特的算法和数据处理能力,实现了对海量信息的快速处理和分析。那么,Sora可以做什么?Sora有什么功能?可能很多朋友都特别感兴趣,那就跟小编一起来看看吧! 1、文生视频 把你的自然语言变成为视频内容,一次可生成长达1分钟的视频。 2、图生视频 根据图片衍生出 -

Sora是什么意思?Sora有哪些优点?

Sora是什么意思?所谓Sora就是美国人工智能研究公司OpenAI发布的人工智能文生视频大模型(但OpenAI并未单纯将其视为视频模型,而是作为“世界模拟器”)。 美国时间2024年2月15日,OpenAI正式发布文生视频模型Sora,并发布了48个文生视频案例和技术报告,正式入局视频生成领域。 Sora可以根据用户的文本提示创建最长60秒的逼真视频,该模型了解这些物体在物理世界中的存在方式,可以深度模拟真实物理世界,能生成具有多个角色、包含特定运动的复杂场景。 Sora对于需要制作视频的艺术家、电影制片人或学生 -

什么是可灵大模型?可灵大模型免费申请方法介绍

什么是可灵大模型?可灵大模型(Kling)是由快手大模型团队自研打造的视频生成大模型,具备强大的视频生成能力,用户可以轻松高效地完成艺术视频创作。可灵大模型生成的视频分辨率高达1080p,时长最高可达2分钟(帧率30fps),且支持自由的宽高比。 可灵大模型(Kling)基于快手在视频技术方面的多年积累,采用Sora相似的技术路线,结合多项自研技术创新,效果对标Sora。可灵大模型(Kling)先后开放了文生视频、图生视频、视频续写等功能,还正式发布了移动端、Web端等免费体验服务。 可灵大模型(Kling)主要功