腾讯云AIGC场景解决方案是基于腾讯在高性能计算集群、存储、内容安全领域的技术积累和丰富场景打磨,为有AI内容生成、大模型需求的企业客户快速打造一站式方案。

方案介绍

大规模训练加速

业务痛点

- 大模型训练周期长:模型在多模态、大量参数权重的情况下,训练周期长,无法快速满足业务上线

- 训练工程化门槛高:AI基础设施的工程化涉及面广,需要在训练过程中同时协调算力、网络、模型及数据集的调优

- 开源框架调优困难:在大模型搭建时使用开源框架如Horovod、DeepSpeed等,往往面临复杂的配置调整且难以稳定保持分布式训练提效

解决方案

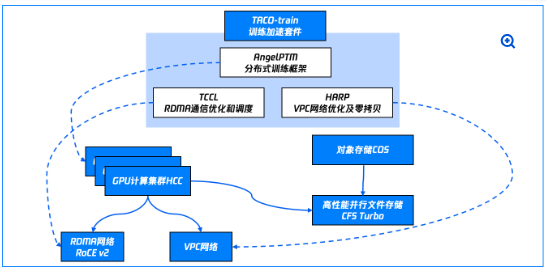

1、高性能GPU集群提速模型训练:通过高性能计算集群,用多机多卡高性能GPU在NVLink和最大3.2Tbps的RDMA网络的硬件优化环境,利用多卡并行优化分布式加速训练效果

2、开箱即用的训练组件:云端GPU型号满足各类模型训练需求,搭配并行文件存储CFS Turbo和对象存储COS,简化搭建工作,满足训练时的无损高带宽和数据集高吞吐

3、简化框架调优并提效:通过TACO加速套件,TCCL感知拓扑流量及拥塞管理,Zero-Cache异构管理显存和内存提升参数量,混合精度训练及模型并行优化,降低门槛并提效

大规模推理优化

业务痛点

- 推理GPU资源难以统一管理:面对不同推理场景,难以用一款GPU机型服务不同推理服务,面临多样化GPU资源的管理

- 推理服务性能低下:难以在GPU推理时有效提升业务装载量,单机QPS低下,性能不足

- GPU资源利用率低:在推理服务对外提供业务时,无法平衡算力资源和显存容量,导致GPU资源利用率低

解决方案

1、丰富的GPU款型选择及统一的容器化推理管理:腾讯云提供丰富多样的GPU款型可供选择,并提供统一的容器服务TKE管理所有GPU推理实例,统一资源调度

2、无侵入优化推理性能:腾讯云推理加速套件,通过图优化、算子融合、编译器优化等手段,无感接入业务并实现高性能推理优化

3、推理混布提升利用率:结合TKE容器服务和qGPU算力显存切分技术,实现不同模型推理服务的灵活混布,支持不同GPU QoS策略极致压榨GPU算力和显存资源,提升利用率

AIGC内容合规

业务痛点

- 用户引导AI模型服务违规:用户输入明显带有违规的引导词、图像等内容,诱导AI模型反馈不合规内容。

- AI模型产生违规内容:当AI模型生成违法或不良内容,如涉黄、涉恐文字或图片时,容易对经营者带来合规风险

解决方案

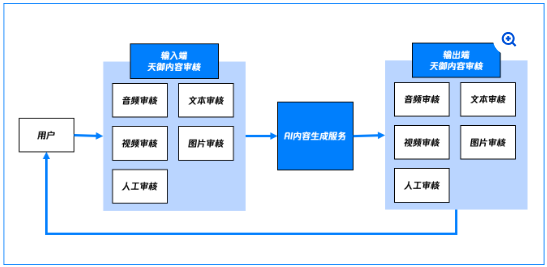

1、用户输入端内容审核:在用户输入提示词或图片时,对用户引导内容进AI模型前执行内容安全审核,确保请求源头合规

2、模型输出端内容审核:在AI模型推理服务产生内容后,预先经过内容审核服务,确保违规内容提前拦截,防止违规内容发送至使用者,降低合规风险

文生图云原生方案

业务痛点

- 业务流量不可控:作为在线业务,推理服务需要合理设计限流熔断,避免流量激增造成整体业务不可用

- 成本无法控制:Stable Diffusion的前向推理过程是一个比较耗时的过程,GPU应用部署对比CPU应用部署成本也较高,如何控制成本是需要重点考虑的因素

- 服务加载速度慢:模型文件加上推理服务,镜像体积可能达到几十GB,拉取镜像时间长

解决方案

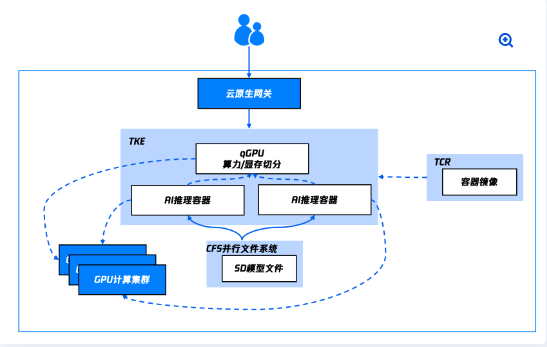

1、腾讯云云原生API网关作为云上微服务架构的流量入口,集成请求分发、API管理、流量监控、访问限制等功能,是微服务架构中的重要组件

2、当业务访问具有明显潮汐现象时,可以通过TKE GPU HPA的弹性能力,进一步降低资源部署成本

3、企业版容器仓库支持按需加载容器镜像,提升应用分发效率

智能客服场景方案

业务痛点

- 效果差:基于开源模型的智能客服落地比较受限,比较小的开源模型做智能客服效果不尽人意

- 缺少上下文学习能力:开源模型受限于其训练方式,缺乏良好的长度外推性,当文本长度增长后,生成质量会显著下降

- 企业私有数据无法公开:目前大模型均为预训练模型,仅能学习公开数据,无法学习企业私有数据

解决方案

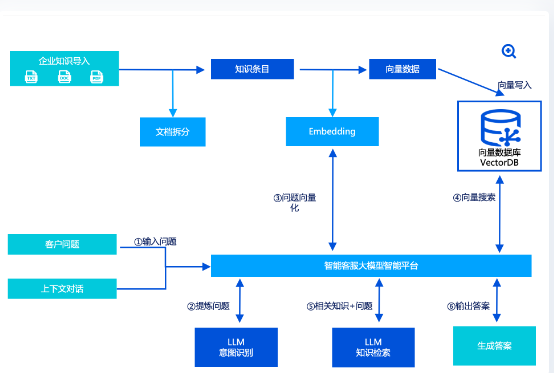

1、客服引导式话术:大模型理解引导式话术,在用户问题不完整的情况下,通过与用户的互动,逐步引导用户提问,服务更加友好

2、多轮对话:大模型通过对多轮的深入语义分析和精准理解,让用户感受到仿佛真正与人沟通的体验,实现了自然、流畅的对话,增强了与用户的亲近感

3、推理问题生成答案:通过腾讯云向量数据库为大模型提供外部知识库,提高大模型回答的准确性,单索引行数可达10亿行

热卖产品推荐