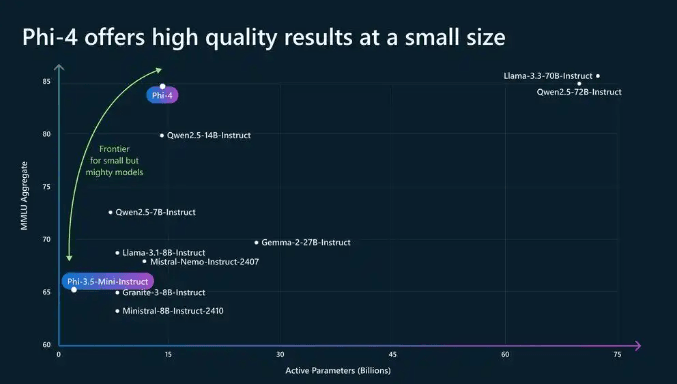

近日,微软在官网开源了三款基于Phi-4架构的新型小参数模型,分别是Reasoning、Min-Reasoning和Reasoning-plus。其中,Reasoning模型是以Phi-4为基础打造的,Min-Reasoning模型特别适合在平板、手机等移动设备上运行,而Min-Reasoning模型则经过强化学习优化,专门针对数学等特定领域进行了强化训练。

这三款模型的最大亮点之一便是算力消耗非常低,可以直接在消费级硬件环境上运行,以普通的Windows 11设备为例,无论是CPU还是GPU,都能轻松实现本地部署。同时微软已经将Phi-4系列模型深度融入Windows系统生态,使其成为Copilot+PC的重要组成部分。根据测试数据显示,Phi-4-Reasoning-plus版本只有140亿参数,但与DeepSeek开源的R1 6710亿参数相比性能几乎差不多。

Phi-4-Reasoning基于微软开源的Phi-4模型构建。为了增强其推理能力,微软采用了结合监督微调与强化学习的训练策略进行深入优化。具体做法是,先通过监督微调让模型学习高质量的推理示例,这有助于模型生成详细且连贯的推理步骤,从而更有效地利用推理过程中的计算资源。此方法相当于为模型提供了一种“参考答案”,指导其如何更准确地完成推理任务。

Phi-4-Reasoning模型基于微软开源的Phi-4架构构建。为了提升其推理能力,微软采用了结合监督微调与强化学习的训练策略进行深度优化。首先,通过监督微调使模型学习大量高质量的推理示范,从而能够生成详细且连贯的推理步骤,有效利用推理时的计算资源,这相当于为模型提供了一个“参考标准”,指导其正确推理。

然而,单靠监督微调并不足以覆盖所有领域的复杂推理需求,因此微软进一步引入了强化学习阶段。该阶段通过设计奖励函数,促使模型在数学推理等特定领域生成更加准确和深入的推理链,起到了激励模型更深入思考的作用,从而显著提升了推理的精度和深度。

在推理流程设计上,Phi-4-Reasoning引入了专门的推理标记如和,用以明确标识推理链的起止位置。这为模型提供了一个组织推理的框架,帮助其更好地构建逻辑严密且连贯的推理过程。同时,该模型支持的最大上下文长度从16K增加到了32K,这极大扩展了模型处理长推理链和复杂任务的能力,避免了因上下文长度受限而导致推理中断的问题。

此外,微软发现使用高质量和合成数据对于训练模型非常重要,于是从多个渠道收集了大量问题,包括公开网站、现有数据集。这些数据涵盖了数学、科学、编程以及与安全相关的任务等多个领域。还通过合成数据生成技术,将部分问题转换为新的形式。例如,将编程问题转换为文字问题,或者对数学问题进行改编,以更好地适应推理训练的需求。这种数据策划和合成策略不仅丰富了训练数据的内容,还为模型提供了更多样化的学习场景,从而提升了模型的泛化能力。