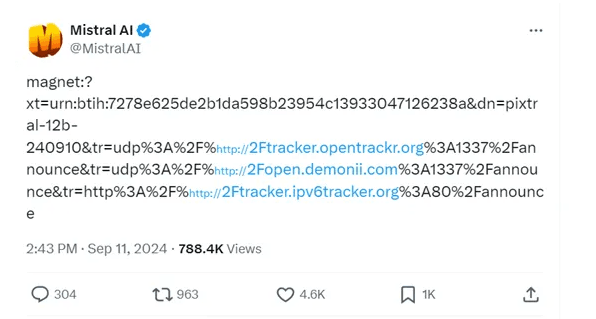

最近Mistral AI发布了Pixtral 12B,是Mistral首款能够同时处理图像和文本的多模态AI大语音模型。

Pixtral 12B模型拥有120亿参数,大小约为24GB,基于文本模型Nemo 12B构建而成,能够回答关于任意数量、任意尺寸图像的问题。与Anthropic的Claude系列和OpenAI的GPT-4o等其他多模态模型类似,Pixtral 12B理论上应能执行诸如为图像添加描述和统计照片中物体数量等任务。

Pixtral 12B模型拥有40层架构、14,336个隐藏维度大小和32个注意力头,配备了400M的专用视觉编码器,支持1024x1024图像尺寸和24个隐藏层的高级图像处理。词汇量大,其词汇表中大约有13万个独特的标记,可实现细致入微的语言理解和生成。

Pixtral 12B的核心亮点:

1、舒适的数据处理能力

与其他多模态模型,如Anthropic的Claude系列和OpenAI的GPT-4o不同,Pixtral 12B更加注重在交互过程中保持文本与图像的紧密结合。通过120亿的参数,Pixtral 12B不仅能够为用户提供简单的图像描述,还能够统计和分析图像中的物体数量、属性等信息。这类功能显著提升了用户在日常工作和创作中的效率,并为创意产业的发展提供了新的工具。

2、开放与微调的灵活性

用户可以根据自身需求下载并微调该模型,并可依据Apache 2.0许可证进行多方面的应用。这种自由度大大降低了AI技术的应用门槛,使得更多的创造性用户和创新团队能够受益于这一强大工具。

用户可以下载、微调Pixtral 12B模型,并能依据Apache 2.0许可证使用。

根据数据评测显示,Pixtral 12B在MMMU、Mathvista、ChartQA、DocVQA基准测试平台的数据比Phi-3、Qwen-2 7B等知名多模态模型更好。