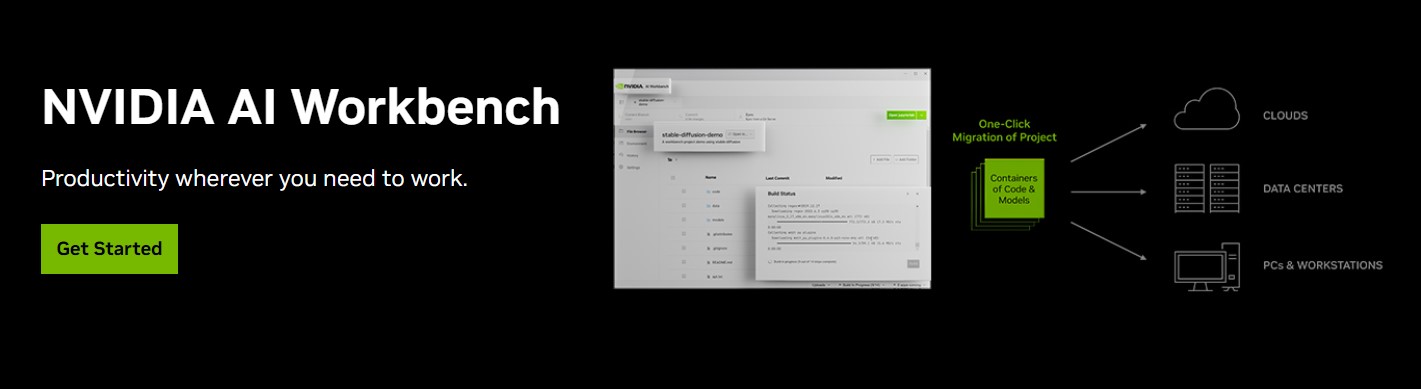

8月9日,全球AI领导者英伟达(NVIDIA)在官网宣布,推出NVIDIA AI Workbench(以下简称“NAW”)以帮助开发人员快速部署、开发生成式AI和大语言模型。据悉,NAW是一个统一、易于使用的开发平台,允许开发人员在PC(支持Windows、Linux等)或工作站上快速创建、测试、定制预训练的生成AI和大语言模型,然后将其扩展到任何数据中心、公共云或NVIDIA DGX云中。

英伟达是最积极推动AIGC发展的企业之一,在8月9日举办的全球“SIGGRAPH 2023”大会,英伟达创始人兼CEO黄仁勋详细介绍了英伟达对生成式AI赛道的深度布局以及发布的多款生成式AI产品,NAW便是主打产品之一。

NAW集成了GitHub、NVIDIA NGC和Hugging Face等开源服务,自托管注册表和Git服务器。用户在Windows和Linux计算机上只需单击一下,即可设置容器和开发人员环境,或者通过JupyterLab和VS Code开发工具,获得最佳GPU优化框架的免设置访问权限。

此外,开发者还可以将NAW连接到NVIDIA AI Enterprise,进一步提升开发效率和体验。AI Enterprise由NVIDIA NeMo、NVIDIA Triton ™管理器和NVIDIA Base Command三大块组成。

NVIDIA NeMo:是一个云原生框架,可用于构建、自定义和部署大型语言模型。借助NeMo,可为用户创建和定制大语言模型应用程序提供端到端支持。

NVIDIA Triton ™管理器:该功能可通过在GPU和CPU上进行资源高效的模型编排,自动在Kubernetes中部署多个Triton Inference Server实例。Triton务支持大规模推理部署,实现高性能和硬件利用率。

NVIDIA Base Command:一个群集管理软件,可帮助企业在数据中心、多云和混合云环境中,最大限度地提高AI服务器的性能和利用率。

简单来说,NAW简化了开发环境配置、连接服务、下载资源、容器配置等繁琐流程,将其整合在一个平台中,加速企业使用生成式AI、大语言模型的进程,实现一站式开发。